El gran botó vermell que pot aturar la intel·ligència artificial

Deep Mind, una 'start-up' de Google, ha desenvolupat un mecanisme que pot interrompre tota la intel·ligència dels seus sistemes en cas d'emergència

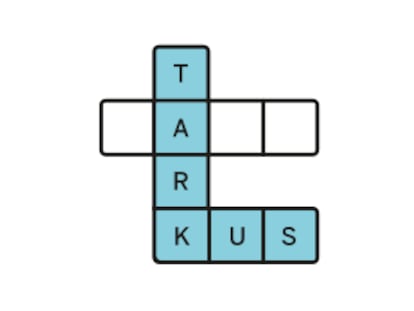

Arribarà un moment en el qual les màquines superaran la intel·ligència dels humans i aquests hauran de disposar d'un sistema de prevenció per poder interrompre-les. No és un altre guió de pel·lícula de ciència ficció, sinó la hipòtesi de la qual parteix un estudi realitzat per Deep Mind, l'empresa de Google especialitzada en intel·ligència artificial, i l'Institut per al Futur de la Humanitat (FHI, per les seves sigles en anglès) de la Universitat d'Oxford. Totes dues empreses han desenvolupat de manera conjunta un “gran botó vermell” d'emergència per evitar que les màquines realitzin una “seqüència d'accions nocives” per a l'entorn, l'operador humà o per a elles mateixes i poder “guiar-les a una situació segura”.

Els desenvolupadors s'han assegurat que les màquines no puguin aprendre a prevenir, impedir o provocar aquestes interrupcions

“És improbable que els agents d'aprenentatge que interaccionen amb un ambient tan complex com el món real es comportin de manera òptima tot el temps”, reconeixen els autors de l'estudi Agents que es poden interrompre de manera segura. Els investigadors sostenen que han creat un “marc de treball que permet a l'operador humà interrompre de forma segura (i fins i tot de manera repetida)” determinats tipus d'intel·ligència artificial. A més, s'han assegurat que les màquines no puguin aprendre a prevenir, impedir o provocar aquestes interrupcions.

“Aquest sistema d'interrupció segura pot ser molt útil per prendre el control d'un robot que s'està comportant malament i que pot portar a conseqüències irreversibles; també perquè superi una situació delicada o realitzi una tasca per la qual no havia après a comportar-se”, reflexionen els autors de l'estudi. "Però no és clar si tots els algorismes poden ser fàcilment interrompibles", admeten.

"Aquest tipus de mesures serveixen per ajudar que la gent accepti la intel·ligència artificial perquè té clar que sempre va a estar controlada

La investigació fa referència a un tipus molt específic d'intel·ligència artificial coneguda com d'aprenentatge reforçat, que combina variables per determinar de manera automàtica —sense necessitat d'un ajust específic— el seu comportament "ideal". "És un tipus d'intel·ligència artificial que ha pres molta força, perquè és més senzill desenvolupar-la. El que fa el robot és maximitzar una espècie de funció matemàtica, però no entén els conceptes sobre els quals treballa. Com que només entén fórmules pot ser possible que existeixi el problema potencial que decideixi ignorar o fer mal als humans que l'han programat, però és alguna cosa improbable", explica Juan Antonio Recio, director del departament d'Enginyeria del Software i Intel·ligència Artificial de la Universitat Complutense de Madrid.

No obstant això, Recio sosté que aquest problema no ocorreria amb un altre tipus d'intel·ligències que en comptes d'entendre formules, entenguessin conceptes com a humà, com és la intel·ligència simbòlica. "De totes maneres, aquest tipus de mesures serveixen per tranquil·litzar la societat, per ajudar que la gent accepti aquesta intel·ligència artificial perquè té clar que sempre estarà controlada, que mai se n'anirà de les mans", considera aquest expert.

Desenvolupament d'una 'superintel·ligència'

Aquest tipus de reflexions no són noves en el sector de la intel·ligència artificial. El director de l'Institut per al Futur de la Humanidad, Nick Bostrom, ja descrivia com a escenari possible en el seu llibre Superintel·ligència: camins, perills, estratègies com que les màquines superarien els seus programadors, serien tan intel·ligents i capaços de millorar-se a si mateixes i perdrien el planeta. "Hem de saber com controlar-les. Si tens un agent artificial amb objectius diferents als teus, quan es torna prou intel·ligent, és capaç d'anticipar les teves accions i de fer plans tenint en compte els teus, fet que podria incloure amagar les seves pròpies capacitats de manera estratègica", sostenia en una entrevista amb aquest diari.

“Algunes persones han expressat les seves preocupacions sobre un agent superintel·ligent que es resisteixi a ser apagat”, deien els autors en el seu estudi, encara que sense atrevir-se a especificar quan podria passar alguna cosa així. Altres experts en intel·ligència artificial que Bostrom cita al seu llibre afirmen que hi ha un 90% de possibilitats que entre el 2075 i el 2090 hi hagi màquines tan intel·ligents com els humans.

Sobre la firma